在12月,我们通过发布实验版的Gemini 2.0 Flash拉开了智能代理时代的序幕——这是我们为开发者提供的高效工作马模型,具有低延迟和增强的性能。今年早些时候,我们在Google AI Studio更新了2.0 Flash Thinking Experimental,通过结合Flash的速度和解决更复杂问题的能力,提升了其性能。

上周,我们向所有桌面和移动设备的Gemini应用用户提供了更新后的2.0 Flash,帮助大家发现与Gemini创建、互动和协作的新方式。

今天,我们通过Google AI Studio和Vertex AI的Gemini API正式发布了更新的Gemini 2.0 Flash,开发者现在可以使用2.0 Flash构建生产应用。

我们还发布了Gemini 2.0 Pro的实验版本,这是我们迄今为止在编码性能和复杂提示方面表现最好的模型。它在Google AI Studio和Vertex AI中可用,并且在Gemini应用中为Gemini高级用户开放。

我们在Google AI Studio和Vertex AI中公开预览发布了一个新模型,Gemini 2.0 Flash-Lite,这是我们迄今为止最具性价比的模型。

最后,2.0 Flash Thinking Experimental将在桌面和移动设备的Gemini应用中提供给用户选择。

所有这些模型在发布时都将具备多模态输入和文本输出功能,更多模态将在未来几个月内准备好供公众使用。有关定价的具体信息,可以在Google Developers博客上找到。展望未来,我们正在为Gemini 2.0系列模型进行更多更新和改进功能的工作。

2.0 Flash:一个新的公开可用更新

在2024年I/O大会上首次推出的Flash系列模型,因其强大的工作性能而受到开发者的喜爱,非常适合大规模的高频高流量任务,并且能够在广泛的信息中进行多模态推理,具有100万标记的上下文窗口。我们很高兴看到开发者社区对它的反响。

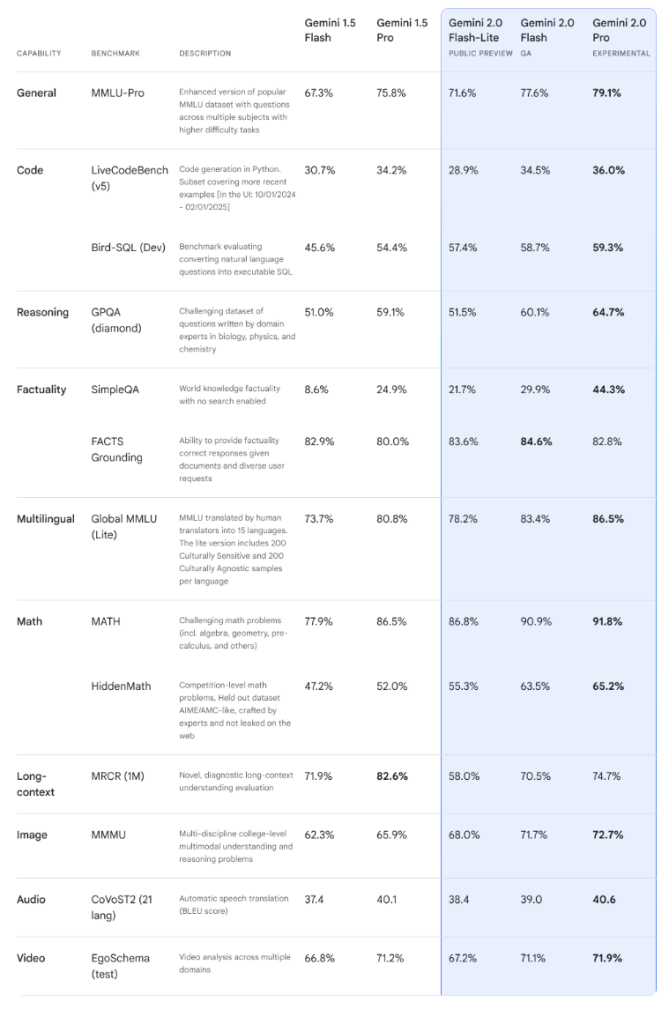

2.0 Flash现在在我们的AI产品中向更多人普遍开放,同时在关键基准测试中性能得到了改善,图像生成和文本转语音功能也将很快推出。

在Gemini应用程序或Google AI Studio和Vertex AI中的Gemini API中尝试Gemini 2.0 Flash。定价详情可在Google开发者博客中找到。

2.0 Pro Experimental:我们迄今为止在编码性能和复杂提示方面最优秀的模型

随着我们继续分享早期的实验版本Gemini 2.0,如Gemini-Exp-1206,我们收到了开发者们关于其优势和最佳使用案例(如编码)的优秀反馈。

今天,我们发布了一个响应这些反馈的Gemini 2.0 Pro实验版本。它在编码性能和处理复杂提示的能力上表现最强,相较于我们迄今为止发布的任何模型,具有更好的理解和推理世界知识的能力。它拥有我们最大的上下文窗口,达到200万标记,使其能够全面分析和理解大量信息,并具备调用工具(如Google搜索和代码执行)的能力。

Gemini 2.0 Pro 现在作为实验模型可供 Google AI Studio 和 Vertex AI 的开发人员使用,并在桌面和移动设备的模型下拉菜单中提供给 Gemini Advanced 用户。

2.0 Flash-Lite:我们迄今最具成本效益的型号

我们收到了很多关于1.5 Flash的价格和速度的积极反馈。我们希望在保持成本和速度的同时,继续提高质量。因此,今天我们推出了2.0 Flash-Lite,这是一款比1.5 Flash质量更高的新型号,同时保持相同的速度和成本。在大多数基准测试中,其性能优于1.5 Flash。

与2.0 Flash一样,它具有100万个令牌的上下文窗口和多模态输入。例如,它可以为大约40,000张独特的照片生成相关的单行标题,在Google AI Studio的付费层中费用不到一美元。

Gemini 2.0 Flash-Lite在Google AI Studio和Vertex AI公开预览中提供。